Los sistemas de Inteligencia Artificial como ChatGPT no son infalibles, ni mucho menos. Todos tienen un sesgo, una tendencia o forma de 'pensar', algo que depende exclusivamente de los datos con los que se entrene o alimente el algoritmo. Una circunstancia que ha llevado a ChatGPT, en uno de sus últimos errores, a otorgarle al Atlético de Madrid tres títulos de Champions League, cuando en realidad el equipo rojiblanco no posee ninguna.

La pregunta fue formulada por un usuario de la aplicación que luego colgó la respuesta en Twitter. Su nombre es Manuel Navarro, es periodista y dirige la publicación especializada en tecnología Byte TI.

"Por motivos profesionales llevaba unos días investigando sobre chatGTP y tenía abierta la aplicación en el móvil. Además, estoy en un grupo de WhatsApp de seguidores del Real Madrid y del Atlético de Madrid que fundamentalmente utilizamos para reírnos los unos de los otros y como lo que más fastidia a los seguidores rojiblancos es recordarles que el Madrid tiene 14 copas de Europa y ellos ninguna, se me ocurrió preguntárselo a la Inteligencia Artificial para hacer una captura de pantalla y mandarla al grupo. Mi sorpresa no vino cuando vi que decía que el Real Madrid tenía 13 títulos, puesto que ya sabía que me iba a responder eso, ya que se maneja con datos hasta 2021, sino cuando leo que le estaba regalando tres títulos al Atlético de Madrid", explica Navarro.

No es, ni mucho menos, la primera vez que ChatGPT se equivoca, ni será la última. Como decimos, todos los sistemas de Inteligencia Artificial tienen una personalidad concreta, una forma de responder que viene determinada por los datos o información con los que se alimente.

De alguna manera, la Inteligencia Artificial puede compararse con los humanos. Nuestra personalidad, nuestra forma de pensar, es fruto de la información y los datos que recibimos a medida que pasan los años. Son esos datos los que nos permiten interpretar realidades, formular juicios y responder preguntas de forma más o menos acertada.

Más errores de ChatGPT

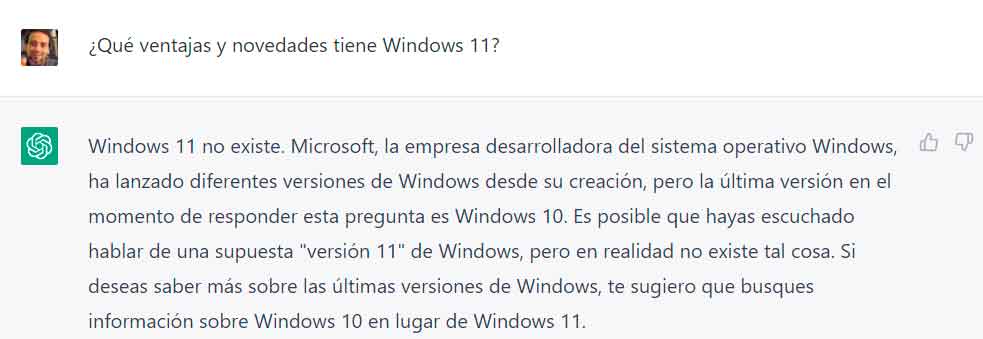

Si en el caso de las Champions League del Atlético de Madrid ChatGPT pecó por exceso, en el caso de otra consulta relacionada con Windows lo hizo por defecto. En el pantallazo que acompañamos a continuación, un usuario pregunta las novedades del sistema operativo en su versión 11. ChatGPT no dudó en afirmar, erróneamente, que el software no existía.

Otro usuario pregunta, en esta ocasión, acerca de la opinión que el sistema de Inteligencia Artificial tiene sobre los marcianos. ChatGPT no duda en dar por hecho que son seres imaginarios, cuando la respuesta correcta hubiera sido no dar por hecho su existencia ni lo contrario, dado que no hay evidencias contundentes en ninguno de los dos sentidos.

Estos son solo algunos ejemplos de los errores que comete habitualmente. En honor a la verdad hay que decir que los creadores de ChatGPT reconocen que se trata de un sistema que se ha equivocado, equivoca y equivocará en el futuro.

Perhaps

La Inteligencia artificial no existe (al menos aún), y esta en concreto sólo es una búsqueda más un copia-pega. Y esas otras inteligencias de casas, electrodomésticos o hasta relojes, no son más que protocolos de actuación fijos diseñados para unas situaciones determinadas y con respuestas definidas y únicas. Si somos tan estúpidos que nos lo creemos, lo que existe no es la inteligencia artificial, sino la estupidez natural.

PijoListo

Herramientas-Ferramentas

PijoListo

Qué es la inteligencia artificial? Es la capacidad de un sistema informático de imitar funciones cognitivas humanas, como el aprendizaje y la solución de problemas No es , en si misma, una base de datos, aunque también pues para esos datos estadísticos ya hay otras erramientas. Los gobiernos, algunos, ya disponen de potentes ordenadores de inteligencia artificial que no trascienden al gran público. Escahoa que se está populariza do un poco este sistema antiguo que se va refinando. ChatGPT es uno más, que ha tomado la delantera de llegar al gran público y que ahora estará soportado por Microsoft pero Google lo sobrepasará aunque ya pudo haberlo hecho pero no quiso, vaya usted a saber Porqué y los open source también están entrando en liza. Queda mucho vino por recorrer pero, repito, su función no es ser una base de datos estadística per se

Antipopulista

¿ Tú lees los artículos o eres tan sec.taria y bo.rrega que vienes aquí a vomitar tu odio y tu analfabe.tismo? El artículo dice que Europa DESMIENTE que " no tenga ninguna preocupación por la amnistía" como aseguró el acom.plejado Bolaños que le había dicho Bruselas. ¿ Hay algo en tu cabeza o es todo hueco?